Secretos expuestos, hackers y el fin de Internet tal y como lo conocemos...

Una semana ramdom de 2024

📍Te escribo desde: LA piscina

💪 Mood: Acalorado

💬 Hoy te hablo de: Hacker, de OpenIA y de google

🎸 Escuchando: El antipodcast de Fefo.

Desde la piscina se ve el mundo de manera diferente… el tiempo pasa de manera distinta, de manera pausada…. Asi que este fin de semana mientras escribo estas lineas con ayuda de la IA de Cohere paso los calores de esta época con medio cuerpo metido en la piscina. y el macbook en el borde, mascando la tragedia. Venga vamos con las noticias de la IA y alguna que otra tontería.

El gran hackeo a OpenAI

Empezamos con una noticia que ha sacudido los cimientos de la industria de la IA: un hacker ha accedido a la mensajería interna de OpenAI, la empresa detrás de ChatGPT. Y no, no fue hace mucho, fue a principios de este año, 2023, cuando ChatGPT ya estaba en el mercado. ¡Madre mía, qué vergüenza para OpenAI! 😱

Según The New York Times, este incidente revela vulnerabilidades significativas en la seguridad de una de las empresas líderes en IA. El hacker consiguió acceder a foros de mensajería internos donde los empleados discutían tecnologías en desarrollo. Menos mal que no pudo acceder al código fuente ni a los sistemas centrales de IA. Pero, aun así, es bastante preocupante, ¿no os parece?

OpenAI, en lugar de ser transparente, decidió mantener el incidente en secreto y no informar al FBI. Su excusa fue que solo se había accedido a mensajería, pero, aun así, es información confidencial. Esto ha avivado el debate sobre la solidez de las medidas de seguridad de OpenAI y los riesgos inherentes al desarrollo de IA.

Leopold Aschenbrenner, un ex empleado de OpenAI, comentó que la empresa no hace lo suficiente para protegerse del espionaje extranjero. Y, sorpresa sorpresa, lo despidieron después de hacer estos comentarios. 👀 OpenAI ha empezado a reforzar su seguridad, pero muchos se preguntan si es suficiente y si se necesitan regulaciones gubernamentales más estrictas para evitar el espionaje en este campo tan sensible.

ChatGPT expone sus secretos

Y hablando de OpenAI, parece que ChatGPT, su querido hijo, ha estado revelando secretos también. Resulta que ChatGPT compartió accidentalmente todas sus reglas secretas, y un usuario de TechRadar las descubrió. 🤯

Estas reglas incluyen instrucciones para Dall-E, el generador de imágenes integrado con ChatGPT, y el navegador. Por ejemplo, una de las instrucciones para Dall-E limita la creación a una sola imagen por solicitud, incluso si el usuario pide más. También se enfatiza evitar infracciones de derechos de autor.

Las directrices del navegador, por otro lado, detallan cómo ChatGPT interactúa con la web y selecciona fuentes de información. ChatGPT solo puede ir a internet en circunstancias específicas, como cuando se le pregunta por noticias o información relevante en ese momento. Y, al seleccionar fuentes, debe elegir entre 3 y 10 páginas, priorizando la diversidad y la confiabilidad.

El descubrimiento de estas reglas ha llevado a una conversación sobre "jailbreaking" de sistemas de IA, donde los usuarios intentan eludir las salvaguardias y limitaciones establecidas por los desarrolladores. Algunos incluso han intentado manipular las directrices reveladas para anular las restricciones del sistema. Esto destaca la necesidad de una vigilancia continua y medidas de seguridad adaptativas en el desarrollo de la IA.

La IA de Google y el fin de Internet

Pasamos ahora a Google, que parece estar causando estragos en Internet con su uso de la IA generativa. Un estudio, detectado por 404 Media, sugiere que la mayoría de los usuarios de IA generativa están difuminando las líneas entre lo auténtico y lo engañoso. Los investigadores revisaron estudios previos y unos 200 artículos de noticias sobre el mal uso de esta tecnología.

Según el estudio, las tácticas más comunes de mal uso incluyen la manipulación de la apariencia humana y la falsificación de pruebas, a menudo con la intención de influir en la opinión pública, facilitar estafas o generar ganancias. Y, por si fuera poco, el estudio también señala que los sistemas de IA generativa son cada vez más avanzados y accesibles, requiriendo mínima experiencia técnica. Esto está distorsionando nuestra comprensión colectiva de la realidad socio-política y el consenso científico.

Lo irónico es que Google, siendo una de las empresas líderes en este campo, ha cometido errores significativos al implementar IA generativa. Y, como resultado, Internet se está inundando de contenido falso de baja calidad, similar al spam. Esto está sobrecargando a los usuarios con tareas de verificación y aumentando el escepticismo hacia la información digital en general.

Además, hay casos en los que individuos de alto perfil pueden explicar pruebas desfavorables como generadas por IA, lo que traslada la carga de la prueba de manera costosa e ineficiente. A medida que empresas como Google continúen integrando IA en todo, podemos esperar más situaciones similares. La pregunta es: ¿cómo vamos a manejar esta creciente ola de desinformación? 🤔

La utilidad que tanto esperais.

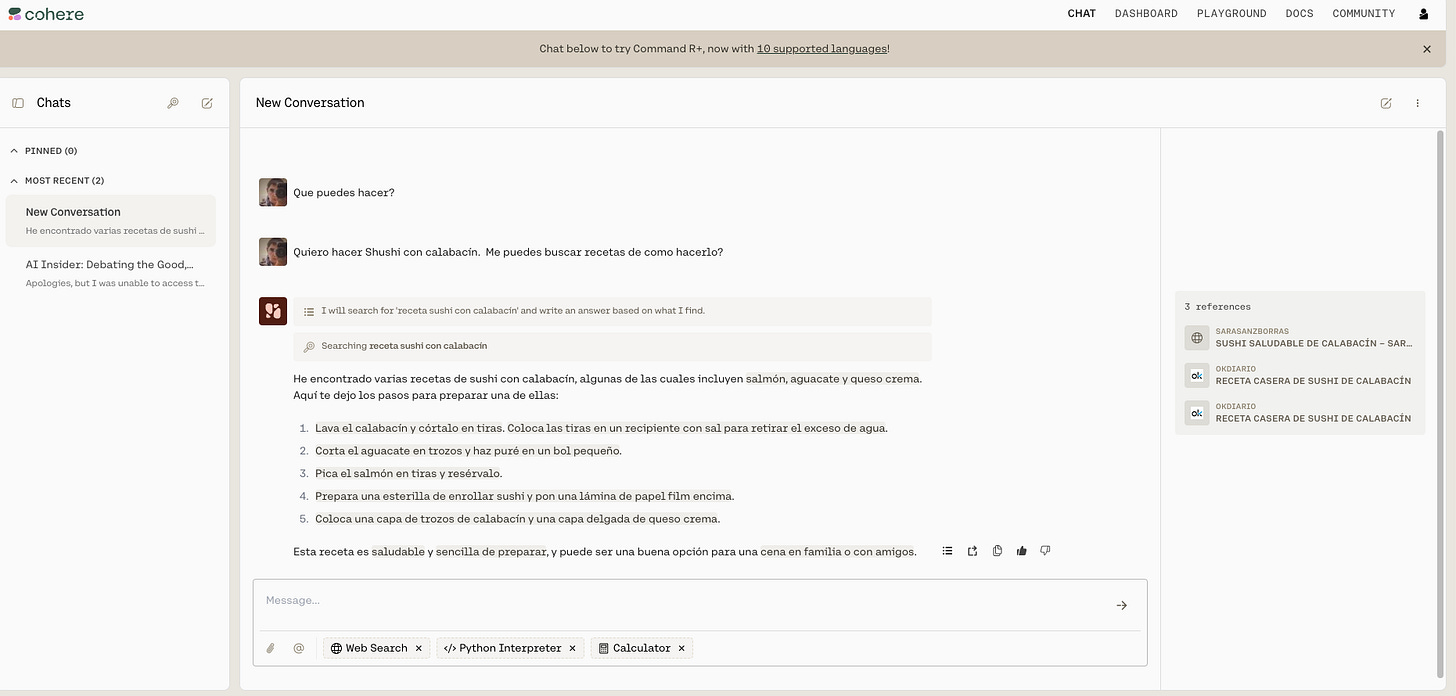

Os he hablado varias veces de Perplexity varias veces. Es una veb que usa Chat GPT para ofrecerte respuestas…. sin que tengas que navegar por webs. La verdad es que la uso bastante a menudo, y ademas tengo el widget en mi Android, pero he descubierto otra que funciona muy bien como perplexity, y es gratis. Coral de Cohere…. darle un vistazo por que os va a gustar.

Reflexiones finales

Bueno, esta semana ha sido intensa en el mundo de la IA. Hackers, secretos expuestos y el posible fin de Internet tal y como lo conocemos. ¿Qué nos deparará el futuro? ¿Conseguiremos controlar el poder de la IA antes de que sea demasiado tarde? Solo el tiempo lo dirá. Mientras tanto, manteneos alerta y no os creáis todo lo que veáis en Internet, porque puede que no sea tan real como pensáis.

Y, por supuesto, si queréis seguir recibiendo estas newsletters y estar informados sobre el mundo de la IA, no olvidéis suscribiros. Carlos y Pistón. 🐶